Модели многоязыковые и мультимодальные: из коробки поддерживается 35 языков (при обучении использовано более 140 языков), а на входе может обрабатываться текст и изображения (модели E2B и E4B дополнительно поддерживают обработку звука). Модель 26B A4B основана на архитектуре MoE (Mixture-of-Experts), при которой модель разделена не серию экспертных сетей (при генерации ответа могут использоваться только 3.8 млрд параметров, но скорость существенно выше классических больших моделей), а остальные варианты используют классическую монолитную архитектуру.

Модели поддерживают рассуждения и настраиваемые режимы обдумывания, поддерживают системную роль (System Role) для обработки инструкций (правил, ограничений) отдельно от данных. Модели могут использоваться для написания кода, распознавания объектов на изображениях, покадрового анализа видео, разбора документов и PDF, оптического распознания печатного и рукописного текста (OCR), распознания речи и перевода между языками. Возможно использование в качестве автономных агентов, взаимодействующих с различными инструментами и API.

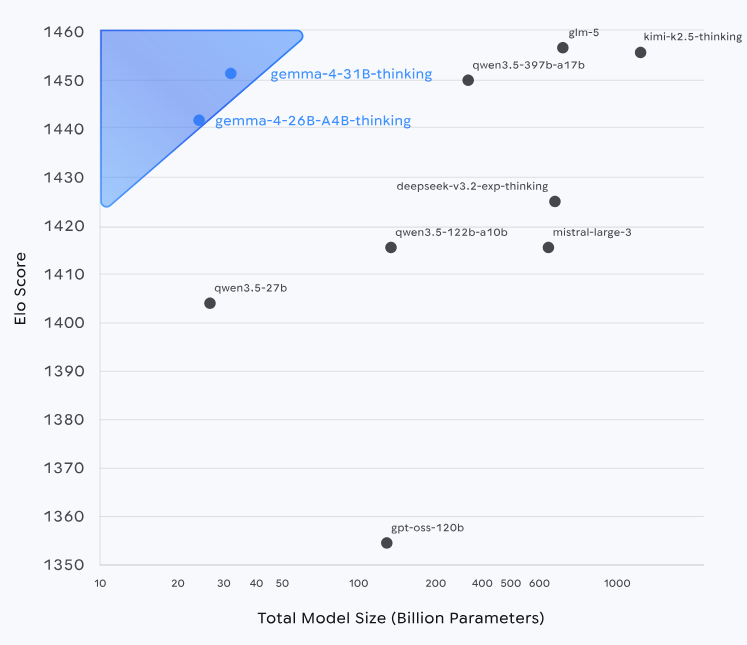

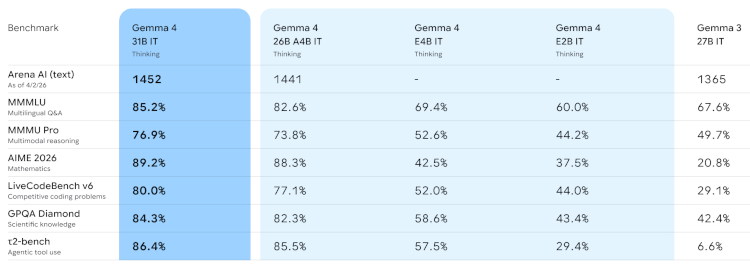

В большинстве тестов модели серии Gemma 4 существенно превзошли модель Gemma 3 c 27 мдрд параметров. Поддерживается использование Gemma 4 с инструментами и библиотеками LiteRT-LM, vLLM, llama.cpp, MLX, Ollama, NVIDIA NIM and NeMo, LM Studio, Unsloth, SGLang, Cactus, Basetan, MaxText, Tunix и Keras.

Источник: http://www.opennet.ru/opennews/art.shtml?num=65127